- 요약 일실시예에 따르면, 복수개의 진동자가 배치된 진동 모듈을 포함하는 제1 사용자 단말 및 제2 사용자 단말을 포함하는 감정 표현 시스템에 있어서, 학습이 완료된 제1 딥러닝 모델 이용하여 상기 제2 사용자 단말이 전송한 메시지를 기초로 제2 사용자 단말 사용자의 감정을 결정하고, 상기 결정한 상기 제2 사용자 단말 사용자의 감정에 대응하는 진동을 출력하는 제1 사용자 단말을 포함하고, 상기 제2 사용자 단말은, 학습이 완료된 제2 딥러닝 모델을 이용하여 상기 제2 사용자 단말이 전송한 메시지에 응답하여 상기 제1 사용자 단말이 전송한 메시지를 기초로 제1 사용자 단말 사용자의 감정을 결정하고, 상기 결정한 상기 제1 사용자 단말 사용자의 감정에 대응하는 진동을 출력한다.

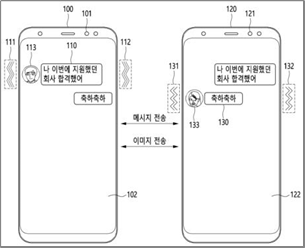

- 대표 청구항 복수개의 진동자가 배치된 진동 모듈을 포함하는 제1 사용자 단말 및 제2 사용자 단말을 포함하는 감정 표현 시스템에 있어서, 학습이 완료된 제1 딥러닝 모델 이용하여 상기 제2 사용자 단말이 전송한 메시지를 기초로 제2 사용자 단말 사용자의 감정을 결정하고, 상기 결정한 상기 제2 사용자 단말 사용자의 감정에 대응하는 진동을 출력하는 제1 사용자 단말을 포함하고,상기 제2 사용자 단말은,학습이 완료된 제2 딥러닝 모델을 이용하여 상기 제2 사용자 단말이 전송한 메시지에 응답하여 상기 제1 사용자 단말이 전송한 메시지를 기초로 제1 사용자 단말 사용자의 감정을 결정하고, 상기 결정한 상기 제1 사용자 단말 사용자의 감정에 대응하는 진동을 출력하되,상기 제2 사용자 단말 사용자의 감정은,긍정 감정, 부정 감정 및 중립 감정 중 적어도 어느 하나에 해당하고, 상기 제2 사용자 단말 사용자의 감정이 긍정 감정인 경우,상기 제1 사용자 단말은,300Hz ~ 400Hz의 진동을 0.2 초 간격으로 상기 제1 사용자 단말에 포함된 상기 진동 모듈 전체에서 5초 동안 출력하고,상기 제2 사용자 단말 사용자의 감정이 부정 감정인 경우,상기 제1 사용자 단말은,700Hz ~ 1000Hz의 진동을 불규칙적인 시간 간격으로 상기 제1 사용자 단말에 포함된 상기 진동 모듈의 무작위(random)한 일부분에서 진동의 위치를 바꿔가며 5초 등 동안 출력하고,상기 제2 사용자 단말 사용자의 감정이 중립 감정인 경우,상기 제1 사용자 단말은,100Hz ~ 200Hz의 진동을 0.5 초 간격으로 상기 제1 사용자 단말에 포함된 상기 진동 모듈 중심부에서 5초 동안 출력하고,상기 제1 사용자 단말 사용자의 감정은,긍정 대응 감정, 부정 대응 감정 및 중립 대응 감정 중 적어도 어느 하나에 해당하고, 상기 제1 사용자 단말 사용자의 감정이 긍정 대응 감정인 경우,상기 제2 사용자 단말은,500Hz ~ 600Hz의 진동을 0.2 초 간격으로 상기 제2 사용자 단말에 포함된 상기 진동 모듈 전체에서 5초 동안 출력하고,상기 제1 사용자 단말 사용자의 감정이 부정 대응 감정인 경우,상기 제2 사용자 단말은,20Hz ~ 30Hz의 진동을 불규칙적인 시간 간격으로 상기 제2 사용자 단말에 포함된 상기 진동 모듈의 일부분이 위에서 아래로 순차적으로 내려가며 진동의 위치를 바꿔가며 5초 동안 출력하고,상기 제1 사용자 단말 사용자의 감정이 중립 대응 감정인 경우,상기 제2 사용자 단말은,150Hz ~ 250Hz의 진동을 0.5 초 간격으로 상기 제2 사용자 단말에 포함된 상기 진동 모듈 중심부에서 5초 동안 출력하고,상기 제1 사용자 단말은,상기 제2 사용자 단말을 식별하기 위한 식별정보를 기초로 상기 제2 사용자 단말로 제2 사용자 단말 사용자의 이미지 전송을 요청하고, 제2 사용자 단말 사용자에 대한 이미지 전송 요청에 응답하여 상기 제2 사용자 단말이 전송한 상기 제2 사용자 단말 사용자의 이미지를 획득하고, 상기 획득한 제2 사용자 단말 사용자의 이미지를 기초로 학습이 완료된 제1 생성적 적대신경망(Generative Adversarial Network, GAN)을 이용하여 상기 결정한 상기 제2 사용자 단말 사용자의 감정에 대응하는 표정을 갖는 제2 사용자 단말 사용자 이미지를 생성하고, 상기 생성한 제2 사용자 단말 사용자의 감정에 대응하는 표정을 갖는 제2 사용자 단말 사용자 이미지를 출력하고,상기 제2 사용자 단말은,상기 제1 사용자 단말을 식별하기 위한 식별정보를 기초로 상기 제1 사용자 단말로 제1 사용자 단말 사용자의 이미지 전송을 요청하고, 제1 사용자 단말 사용자에 대한 이미지 전송 요청에 응답하여 상기 제1 사용자 단말이 전송한 상기 제1 사용자 단말 사용자의 이미지를 획득하고, 상기 획득한 제1 사용자 단말 사용자의 이미지를 기초로 학습이 완료된 제2 생성적 적대신경망(Generative Adversarial Network, GAN)을 이용하여 상기 결정한 상기 제1 사용자 단말 사용자의 감정에 대응하는 표정을 갖는 제1 사용자 단말 사용자 이미지를 생성하고, 상기 생성한 제1 사용자 단말 사용자의 감정에 대응하는 표정을 갖는 제1 사용자 단말 사용자 이미지를 출력하는 감정 표현 시스템..

-

대표 도면

-

전략기술 분류

첨단로봇·제조

인간, 로봇 상호작용 - 출원번호 10-2023-0075183 KIPRIS

- 출원일 2023-06-12

- 공개번호

- 공개일

- 등록번호 10-2617115

- 등록일 2023-12-19

- 우선권 번호

- 우선권 국가

- 우선권 주장일

- 현재 상태 등록

- 현재 권리자 광운대학교 산학협력단

- IPC 코드 G06N-003/02, G06F-003/048, G06F-003/01

Copyright ⓒ 한국연구재단 기술사업화센터 (NRF-TCC) All rights reserved.